|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

[디지털데일리 이건한 기자] AI 인프라 솔루션 기업 모레(MOREH)가 자체 개발한 한국어 대형언어모델(LLM) 파운데이션 모델인 'Llama-3-Motif-102B'(이하 'Motif')를 허깅페이스에 오픈소스로 공개한다고 3일 밝혔다.

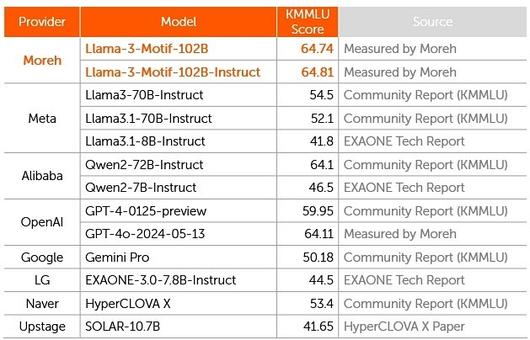

모레는 메타가 자체 LLM 라마(Llama)를 오픈소스로 공개한 이후 전세계 AI 생태계가 빠르게 확장된 것처럼, 고성능 한국어 LLM을 오픈소스로 배포해 한국 AI 생태계 성장에 기여한다는 계획이다. 'Motif'는 1020억개의 매개변수(파라미터)로 구성된 한국어 LLM이다. 모레에 따르면 한국판 AI 성능 평가 체계인 'KMMLU' 벤치마크에서 64.74점을 기록해 오픈AI, 메타, 구글, 네이버의 LLM보다 높은 한국어 처리 성능을 보였다.

|

<이미지를 클릭하시면 크게 보실 수 있습니다> |

모레는 이런 성능이 1870억개에 달하는 방대한 양의 한국어 학습량과 독자적인 학습 기법 덕분이란 설명이다. 모레는 웹상에서 수집 가능한 글 외에도 공개된 전문 분야 문서(국내 특허 및 연구 보고서 등)를 학습 데이터로 활용한다. 또한 국내 최대 규모의 한국어 정제 데이터를 확보해 학습에 포함시켰다. Motif는 사전 훈련된 언어모델과 지시사항을 따르는 데 특화된 인스트럭트 모델 2가지 버전의 오픈소스가 공개된다.

모레는 이번 한국어 LLM 개발에 앞서 올해 초 영어 LLM도 선보였다. 700억개의 매개변수를 가진 거대언어모델인 모레의 'MoMo-70B'도 세계 최대 머신러닝 플랫폼 허깅페이스에서 운영하는 ‘오픈 LLM 리더보드’ 평가에서 77.29점으로 1위에 오른 바 있다. 모델 개발 착수에서 1위 달성까지 단 3개월만에 거둔 성과다. Motif는 이런 개발 과정에서 얻은 노하우를 바탕으로 더 복잡한 문장을 학습(depth)하고, 대화에서 유려한 표현(width)을 만들어내도록 설계됐다.

모레가 이처럼 단기간에 영문과 국문 LLM 분야에서 세계 1위 수준의 두각을 나타낼 수 있었던 것은 AI 모델 개발을 위한 최적의 인프라인 AI 플랫폼 기술을 자체 개발해 보유하고 있기 때문이다. 고성능 LLM을 빠르게 개발하기 위해서는 무엇보다 효율적인 모델 학습 방법을 확보하는 것이 중요한데 모레의 ‘MoAI’ 플랫폼은 고도의 병렬화 처리 기법을 통해 대규모 AI 모델을 효율적으로 개발하고 학습할 수 있도록 돕는다.

한편 모레는 AI 모델 사업 본격 추진을 위한 자회사도 설립할 예정이다. 아직 구체적인 형태는 공개되지 않았지만, 모래 관계자에 따르면 신규 비즈니스 모델 발굴을 위한 국내 자회사가 될 예정이다. 모레는 향후 우수한 AI 인프라 소프트웨어 기술력을 바탕으로 IP 산업과 같은 창작 영역을 비롯해 의료, 법률, 금융 등 전문 영역에 특화된 LLM을 개발하고 멀티모달형 모델 개발에 나서는 등 AI 모델 허브를 목표로 사업을 추진한다는 계획이다.

조강원 모레 대표는 "끝없는 실험과 개발 여정을 통해 개발한 고성능 LLM을 누구나 활용할 수 있도록 오픈소스로 공개하는 것은 국내 AI 생태계 발전과 소버린 AI에 기여하기 위함"이라며 "우리와 같은 국내 AI 산업 발전을 위해 노력하는 스타트업 등 많은 기업들이 적극 활용해주시면 좋겠다"고 말했다.

- Copyright ⓒ 디지털데일리. 무단전재 및 재배포 금지 -

이 기사의 카테고리는 언론사의 분류를 따릅니다.

기사가 속한 카테고리는 언론사가 분류합니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.

언론사는 한 기사를 두 개 이상의 카테고리로 분류할 수 있습니다.